搜索

专题:DeepSeek为何能移动全球AI圈 文 | 新浪科技 周文猛 2025年蛇年春节前夜,DeepSeek透顶出圈了。 1月27日,DeepSeek应用登顶苹果好意思国地区应用商店免费App下载排名榜,在好意思区下载榜上高出了ChatGPT。同日,苹果中国区应用商店免费榜露馅,DeepSeek成为中国区第一。 DeepSeek究竟利弊在那处?近日,浙江大学计较机博士、好意思国南加州大学拜谒学者、《业务运行的保举系统:要领与施行》作家傅聪在与新浪科技相似中,通晓了DeepSeek得手出圈背后

专题:DeepSeek为何能移动全球AI圈

文 | 新浪科技 周文猛

2025年蛇年春节前夜,DeepSeek透顶出圈了。

1月27日,DeepSeek应用登顶苹果好意思国地区应用商店免费App下载排名榜,在好意思区下载榜上高出了ChatGPT。同日,苹果中国区应用商店免费榜露馅,DeepSeek成为中国区第一。

DeepSeek究竟利弊在那处?近日,浙江大学计较机博士、好意思国南加州大学拜谒学者、《业务运行的保举系统:要领与施行》作家傅聪在与新浪科技相似中,通晓了DeepSeek得手出圈背后的时候旨趣。

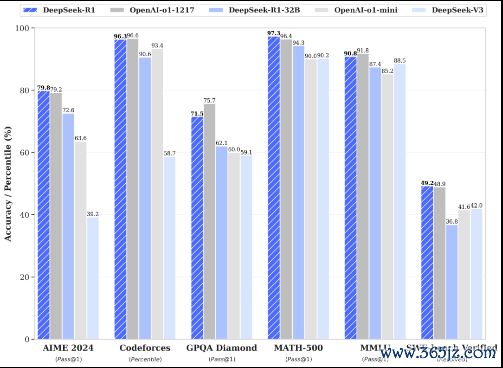

目下,业界关于DeepSeek的喜爱主要汇注在三个方面。第一,在时候层面,DeepSeek背后的DeepSeek-V3及公司新近推出的DeepSeek-R1两款模子,永别散伙了并列OpenAI 4o和o1模子的智力。第二,DeepSeek研发的这两款模子本钱更低——仅为OpenAI 4o和o1模子的特别之一傍边。第三,DeepSeek把这一两大模子的时候齐开源了,这让更多的AI团队,约略基于伊始进同期本钱最低的模子,缔造更多的AI原生应用。

那么,DeepSeek是何如散伙模子本钱的镌汰?同期还保证模子恶果并列OpenAI 4o和o1模子的呢?

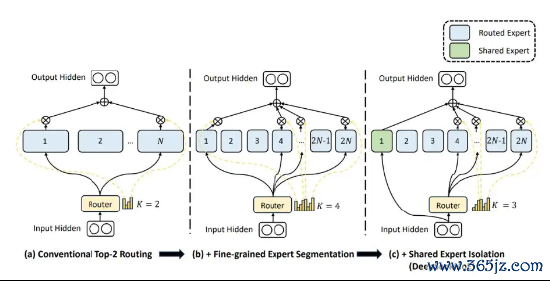

在与新浪科技相似中,傅聪在深刻考虑Deepseek开源论文24小时后暗意:“Deepseek如实有两把刷子,他们通过Multi-Head latent Attention(MLA)和DeepSeek MOE架构,从简了渊博的显存,进而散伙底层算力的高效诳骗,以更低的本钱,试验出愈加出色的模子恶果,这种时候念念路,是在DeepSeek V2版块发布时就照旧获取考据。”

据傅聪先容,目下,DeepSeek用于镌汰模子试验本钱的时候,至少包括以下四类:

第一,DeepSeek使用了一种先进的、不需要缓助耗损函数的人人加载平衡时候,该时候能保证每个token下,少许人人网罗参数被竟然激活的情况下,不同的人人网罗约略以更平衡的频率被激活,贯注人人网罗激活扎堆。

“在DeepSeek V2时,他们在2360亿参数界限的模子上已考据了这一战略的有用性,此次DeepSeekV3他们在6710亿参数界限的模子上进一步考据了这一战略,这个界限基本接近头部玩家目下最佳的商用模子参数界限,咱们也看到deepseek V3所展示出的智力,在benchmark恶果上与GPT4o和Claude-3.5能打个有来有回。”傅聪暗意。

第二,DeepSeek还盘算了一种“对偶活水线(Dual Pipeline)机制”,不错通过极致的活水线转折,把GPU顶用于模子试验中数学运算的算力,和通讯有关的算力在活水线扩展经过中进行“并行粉饰”,散伙了在试验经过通盘的时刻中GPU险些不终止地进走运算。表面上,这个活水线机制,不错让GPU的教唆扩展活水线中的“气泡”,比目下最佳的时候盘算镌汰接近一半,同期只稍稍加多显存的铺张。

第三,DeepSeek时候团队还充分诳骗人人网罗被寥落激活的盘算,截止了每个token被发送往GPU集群节点(node)的数目,这使得GPU之间通讯支出褂讪在较低的水位。

第四,DeepSeek还散伙并应用了FP8夹杂精度试验的架构,在架构中的不同计较技艺,天真地、轮流地使用FP8、BF16、FP32不同精度的“数字暗意”,并在参数通讯的部分经过也应用了FP8传输。在大大加速计较速率的同期,也镌汰了通讯支出。

模子本钱优化外,关于何如进步模子恶果?傅聪指出,除了沿用MLA架构外,DeepSeek还应用了多token展望时候(multi token prediction),使得模子试验的时候,会同期展望序列背面更远的、不同位置的token。这可能使得模子有了对“更远将来”的感知智力,以此增强模子的恶果。

在傅聪看来,DeepSeek V3是一个基础模子,事实上距离OpenAI的o1还有较大距离。竟然匡助DeepSeek追逐o1的是最新模子DeepSeek-R1,该模子险些单纯使用强化学习时候进行“后试验”,让模子的推明智力获取了极大的进步。粗略来说,就是让R1模子在“后试验”经过中,通过学习CoT(念念维链)的时势,一步一步推理得出散伙,而不是径直展望谜底。“这一决策,亦然圈子内大众对OpenAI o1模子散伙旅途的策动,而Deepseek用极快的速率,考据了这所有这个词径的可行性!”傅聪暗意。

在傅聪看来,DeepSeek R1所带来的时候大意,不仅讲明了强化学习(RL)以及 inference time scaling law这条蹊径的可行性。还讲明了即即是小模子(7~13B),也不错通过CoT + RL散伙念念考和自我演化(self- evolution),大幅进步推明智力。之前小模子经常因为幻觉严重,备受诟病,目下看来好多小模子在充分优化后,也具备在应用场景落地的后劲。

此外,R1的出现也会让学界和产业界愈加爱重合成数据,“后试验”时间,对基于CoT念念想的优质合成推理数据的需求,将会大大加多。

海量资讯、精确解读,尽在新浪财经APP

海量资讯、精确解读,尽在新浪财经APP

背负剪辑:何俊熹 开云官网切尔西赞助商